Ni inteligente ni artificial

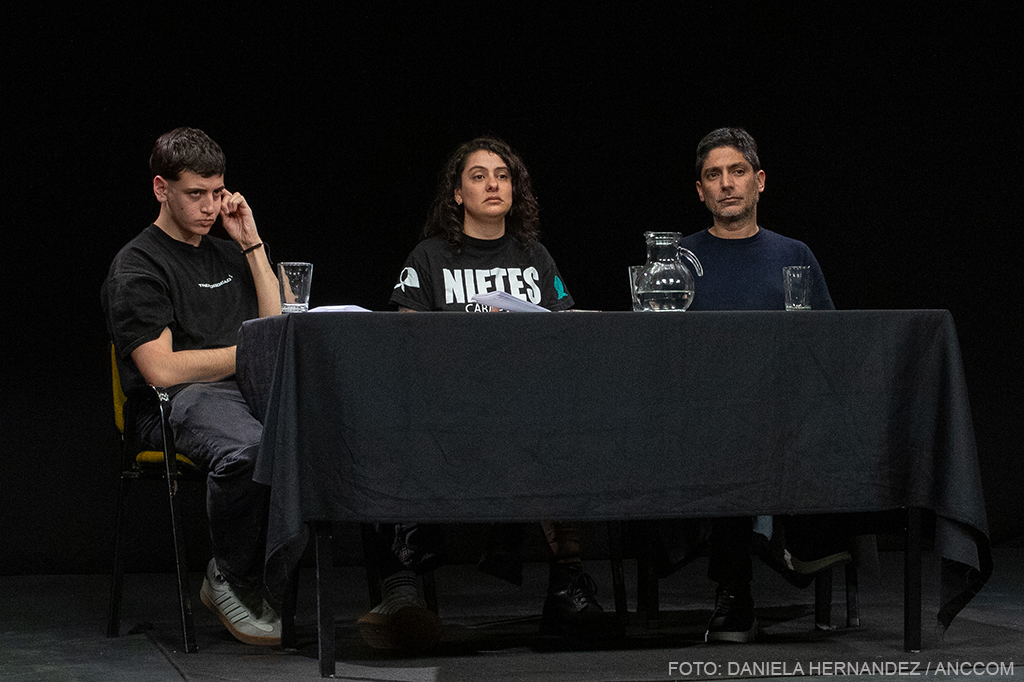

Esteban Magnani, escritor y periodista especializado en tecnología, en su último libro “La mano invisible detrás del algoritmo” analiza las supuestas bondades que trajo el advenimiento de internet que no se cumplieron algo que se repite sistemáticamente con la tecnología, ahora con la inteligencia artificial generativa. Aquí explica en qué consiste la IAG y por qué genera promesas vacías. ¿Una nueva forma de disciplinamiento? El libro se presente este viernes 26 de septiembre en Prometeo.

En la provincia de Santa Fe debutó Zoe, la primera docente virtual latinoamericana diseñada por Chris Meniv. Interactuó en tiempo real con los alumnos, resolvió dudas y propuso actividades. Esta inteligencia se suma al resto de las IA generativas que vienen dando de qué hablar. Esteban Magnani, periodista especializado en tecnología, escritor, docente y también editor de ANCCOM, en su último libro La mano invisible del algoritmo. ¿Qué queda cuando se despeja el humo tecnológico?, recorre el mundo de las cripto, el metaverso, las inteligencias artificiales y el capitalismo de plataformas a partir del caso Uber. “Las IAG deben ser analizarlas en contexto ya que se suman a la burbuja del capitalismo” subraya.

IA generativa, ¿qué es eso?

Según explica Magnani, la inteligencia artificial generativa “va un paso más allá de lo que entendemos en general por inteligencia artificial, si bien siguen siendo términos bastante amplios, lo que llamábamos comúnmente como big data o algoritmos, lo que agrega la IAG es que no sólo organiza y encuentra patrones entre muchos datos sino que puede reorganizar esos datos para productos que, entre muchas comillas, son nuevos”. El especialista detalló que “siempre es una recombinación de lo ya existente o sea estadística y no creatividad”. Retomó una idea de Evgeny Morozov sobre la IA y explicó que “no es inteligencia porque es estadística, lo que hace es encontrar patrones en los datos de entrenamiento, y no es artificial porque depende siempre de la inteligencia humana, que es el insumo necesario para poder hacer esas tareas estadísticas”.

¿Creés que las personas somos conscientes que alimentamos o entrenamos a esas IAs a partir de los rastros que vamos dejando en nuestro paso por internet?

Históricamente las plataformas guiadas por las grandes corporaciones siempre han estado envueltas en un halo de casi pensamiento mágico, como si fuera algo que emana del cielo que cae a nosotros y lo único que podemos hacer es usarlo. Eso se nota en frases como “bueno, no se puede luchar contra la tecnología”, es como si no tuviéramos ningún poder de intervención. La mayoría de la gente no entiende que en realidad lo que hay es una recomendación de productos que fueron tomados de millones de seres humanos sin pedirles permiso. No hay una conciencia y parecería que fuera una inteligencia que está por encima de nosotros, que es neutral y que es capaz de resolver lo que nosotros no logramos. Esto es producto de la ciencia ficción, del exceso de publicidad y marketing que hacen estas empresas, porque obviamente tienen que vender estos productos y convencernos de que son geniales, entonces ocultan sus condiciones de producción.

La idea que tenemos es que las IAs son externas, neutrales y que no tienen nada que ver con nosotros.

Claro, que son algo que simplemente desarrollan las empresas y que no implican un saqueo muy fuerte de productos y de trabajo humano. Hay casos más evidentes como los ilustradores, locutores, diseñadores o escritores, toda gente que que puso en juego su creatividad pero también los trabajadores, todo lo que escribimos nosotros en Google Drive y demás herramientas es retomado por Google y otras empresas, aunque lo nieguen obviamente, para entrenar sus inteligencias artificiales, porque el modelo de desarrollo particular de la IAG, implica modelos cada vez más grandes, que necesitan cada vez más datos y esto hace que se agarre todo lo que haya, de peor o menor calidad, para poder entrenar esas IAs.

¿Esto significa que buscamos una certeza en inteligencias que no son infalibles?

No, está lejísimo de ser infalible. La estadística no es infalible. Es como la frase famosa que una persona come un pollo y otra persona no come nada, la estadística te dice que en promedio se comió medio pollo cada uno pero depende de los datos con los que fueron entrenados, y los datos en general están errados, contienen incluso errores de seres humanos que la IA no cuestiona porque no tiene un criterio. Reproduce lo mismo con lo que fue cargado.

Pensando en los algoritmos y la importancia que tienen, no ya en el plano del marketing y la publicidad sino en el poder de coartar los procesos democráticos en la región, ¿qué rol pueden desempeñar las IAGs en este aspecto?

Te pueden saturar las redes de más basura. Lo que un pensador como Cory Doctorow llama «enshittification”. La enmierdización de internet donde ya es todo imposible de discernir, qué es lo cierto, qué no es cierto, qué vale la pena, que no vale la pena, con algoritmos que están recargados para buscar los puntos más débiles de nuestro cerebro y atraer nuestra atención, incluso contra nuestra voluntad explícita. Si vos multiplicás y saturás los espacios informativos, las redes y demás de basura esto va muy de la mano de lo que propone las políticas de la ultraderecha actual de, como decía Steve Bannon, inundar la zona de mierda y después tomar esa perplejidad de la gente, ese enojo, esa furia que ya no puede discernir demasiado entre lo real y lo no real para llevarla para sus propios intereses. Eso ya viene de los algoritmos anteriores, no tiene necesariamente que ver con la inteligencia artificial generativa, lo que sí hace es facilitar la producción a gran escala de todo esto, aún más de lo que se hacía antes. Ésto lo desarrollo en detalle en el libro anterior, La jaula del confort.

¿Qué qué hay después de que se despeja este humo tecnológico?

En la inteligencia artificial generativa hay una continuidad con otros grandes anuncios de las empresas tecnológicas sobre que habían encontrado una tecnología que iba a revolucionarlo todo. En La jaula del confort (2019) yo retomo casos de tecnologías digitales anteriores como lo referido a Blockchain y lo que eso implicó para todas las criptomonedas, que supuestamente iban a democratizar las finanzas e iban a impedir la financiarización de la economía, que genera crisis como la de 2008. Pero después un puñado de grandes financieras usan esta tecnología supuestamente democratizadora para producir ganancias para ellos y crisis brutales para los demás. No alcanzó con la arquitectura tecnológica para evitarlo. Después eso termina derivando en más y más descontrol porque sin el Estado regulando finalmente es la ley del más fuerte. Eso generó la existencia de todas estas Shitcoins, la estafa de Cositorto y otros casos de estafas basados en un discurso exageradamente optimista. ¿Por qué? Porque nunca la tecnología funciona en el vacío y nunca la tecnología alcanza para dar garantías sobre qué va a pasar con el uso social de esas tecnologías. Siempre su destino se juega en la práctica de la sociedad.

¿Meta burbuja y meta verso?

Mirá, Zuckerberg cuando anuncia el metaverso, por ejemplo, lo que está tratando de hacer es ocultar o distraer respecto de que Facebook había llegado a su techo en cuanto a crecimiento de usuarios, entonces asusta a los accionistas y anuncia el metaverso para tratar de revertir esa situación. Generó expectativas y mucho dinero en el corto plazo pero después no se concretó y hoy en día nadie se acuerda del metaverso. Es la necesidad de las grandes corporaciones de sobreprometer para conseguir su financiamiento para hacer las obras y después eventualmente ver cómo lo recuperan. La apuesta que hacen es un poco lo que pasó con Uber, dicen “yo cobro muy barato, me instalo en un lugar y después de romper a la competencia cobro lo que quiero”. En verdad, la IA sirve pero difícilmente para todo lo que dicen. No resuelven los problemas de las alucinaciones de las IAs o los sesgos, e igualmente tienen que prometer que van a resolverlo para financiar esas bestialidades. Si vos leés al mundo académico, lo que dicen de las promesas acerca de la IA es que no es viable.

¿Cómo influyen las IAs en el trabajo en general y en el ámbito del periodismo y la docencia en particular?

En cuanto al periodismo hay una contradicción casi imposible de resolver entre una tecnología que recicla los existentes y un oficio que trabaja con la novedad. Entonces, la única forma en la cual vos podés hacer una nota de un partido de fútbol con IA es porque hubo un humano que previamente describió ese partido y le cargó los datos. La cuestión es que vos tenés un periodismo en crisis en el cual las empresas le piden a los periodistas que hagan treinta notas por día, entonces no te queda otra que usar inteligencia artificial que recicle noticias viejas o noticias que están circulando por otros medios. Esto devalúa aún más al periodismo, es más largo de explicar pero la llegada de las redes sociales se quedó con la torta publicitaria que antes sostenía a los medios, entonces lo que hay es una presión de mercado por abaratar costos como sea. No es una tecnología que en realidad sirva para el periodismo, lo hace muy limitadamente. Por otro lado, las empresas necesitan encontrar fuentes de ingreso para esas tecnologías carísimas, entonces van a los lugares donde hay mucho dinero. La guerra, la educación, la salud, para prenderse a los recursos que limitan estas áreas. Entonces tienen que prometer que va a resolver la cuestión de educación. Seguramente hay formas para que haya un uso crítico. Pero si vos en educación empezás implementando IAG lo que va a hacer es reemplazar en general los usos de tu propio cerebro, que son los que vas a entrenar a la escuela, es como ir al gimnasio con una grúa para que levante el peso por vos, no vas a entrenar los músculos si haces eso. Por eso la inteligencia artificial generativa, en un principio podría ser utilizada críticamente, sobre todo para ver los errores que comete, pero no para lo que vos necesitás desarrollar en los estudiantes. En el plano general, si efectivamente la IAG estuviera en condiciones de reemplazar a millones de profesionales capacitados, a lo largo de unos años dejarían de existir los productos de la inteligencia humana necesarios para entrenarlas, con lo cual pasarían a estar entrenadas por productos de otras inteligencias artificiales, esto aumentaría los sesgos y las alucinaciones. Además, generaría un problema de sostenibilidad en el mediano y largo plazo. Desde ese punto de vista, ahora sirve más como herramienta de disciplinamiento social.

La mano invisible detrás del algoritmo se presentará el 26 de septiembre a las 18, en Prometo Café, Pringles 519, CABA.