La demanda de la vicepresidenta Cristina Fernández contra Google por el agravio publicado en el buscador el último 17 de mayo, abrió un amplio debate que incluye aspectos como los límites de libertad de expresión, la vulneración del honor, la responsabilidad de los intermediarios en Internet, el rol de los Estados en materia regulatoria, el poder de las grandes corporaciones digitales y el lugar cada vez más determinante que ocupan los algoritmos en la vida de los usuarios.

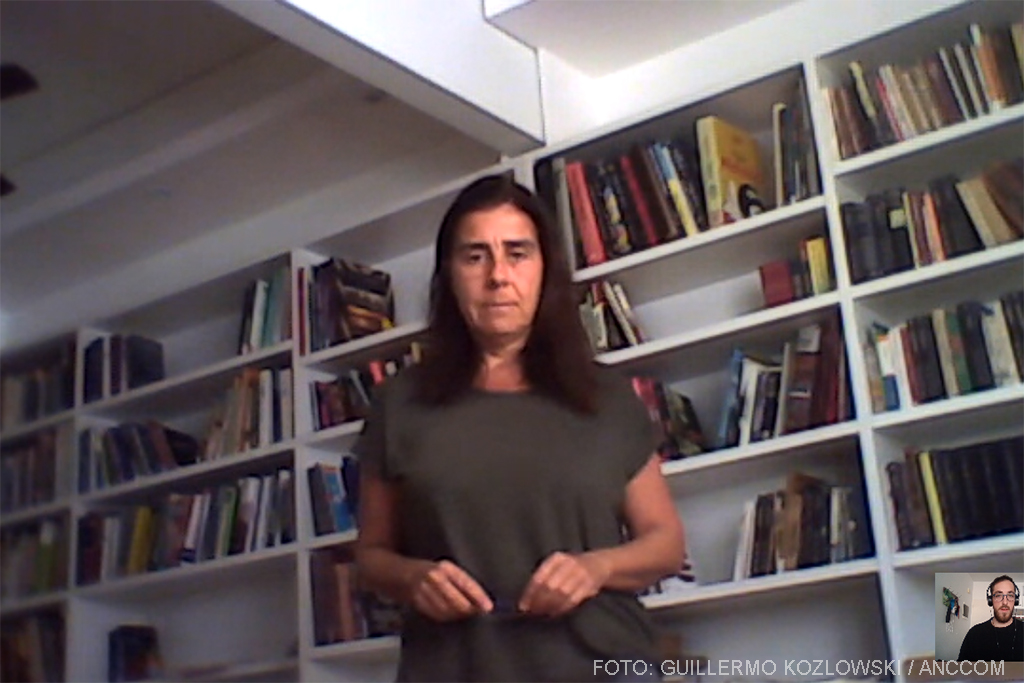

Un panel de expertos reflexionó sobre estas cuestiones en el marco de un conversatorio organizado recientemente por Acces Now y Observacom, dos organizaciones interesadas en la protección de los derechos de los usuarios digitales. En diálogo con ANCCOM, Beatriz Busaniche, directora de la Fundación Vía Libre, sintetiza la idea principal que sobrevoló en el encuentro: “Sería interesante que haya más transparencia sobre cómo funcionan los algoritmos”, afirma.

La pericia informática pedida por los letrados de la vicepresidenta exige a Google revelar cómo su algoritmo selecciona y exhibe la información destacada en el panel de conocimiento. Según Busaniche, esta solicitud conduce a dos problemas: “El primero es que probablemente Google se localice jurídicamente en los Estados Unidos y diga que allá es donde funciona su algoritmo y entonces trate de correr la jurisdicción. La iniciativa de los abogados de Cristina de ponerlo bajo la Ley de Defensa del Consumidor es para tratar de que el conflicto legal quede radicado en la Argentina. La otra cuestión es que, si esto prospera, puede haber algún pleito vinculado con la propiedad intelectual. Porque las empresas, en general, guardan sus secretos industriales bajo siete llaves”.

La directora de Vía Libre señala que, aun “imaginando el mejor escenario” en el que Google muestre su algoritmo, no se tendría total claridad sobre cómo opera: “No es solo su funcionamiento lo que determina el resultado de las búsquedas o de las recomendaciones, sino lo que hace con el volumen de datos que manejan: qué sabe ese algoritmo de cada uno de nosotros cuando hacemos una búsqueda, qué le sirve para ajustar los resultados a muchas de las cuestiones que conoce de la persona que busca y que condicionan también esos resultados”, explica.

Por otra parte, el «recuadro de conocimiento» constituye un caso particular para la especialista: “No es el resultado de una búsqueda lo que está en cuestión, sino ese box donde Google hace una edición diferente. Hay una información destacada, una selección, una referencia a un tercero, Wikipedia en este caso, o como cuando ante una búsqueda de información médica se destacan fuentes médicas confiables. Hay una curaduría diferente de los resultados del buscador. Y por eso es que los abogados de Cristina están tratando de hacer cargo a Google como autor de la calumnia y de la injuria”.

Para Busaniche, esto complejiza y simplifica el caso: “Lo complejiza porque hay que dirimir si Google es un simple expositor, curador, seleccionador, ordenador de información producida por terceros, con lo cual debería primar el régimen de responsabilidad de intermediarios, o si es autor de la calumnia y de la injuria. Si finalmente la Justicia resuelve que Google es responsable en tanto autor o editor de ese contenido, le caben las generalidades de la ley. Es decir, las mismas que podrían caberle a cualquier otro medio de comunicación que tenga una línea editorial y publique una calumnia o una injuria contra una funcionaria pública”.

Sin embargo, Busaniche se muestra escéptica respecto del éxito de la demanda. “Si la Justicia resuelve que hay una cuestión de autoría de Google, dudo que el caso prospere, porque sería un pleito por calumnias e injurias clásico, en el cual deberían probar real malicia. Y si prospera, sería una cuestión seria en términos de libertad de expresión atribuir una responsabilidad editorial a un medio de comunicación por tratar de ladrona a una funcionaria de alto nivel”, algo que también señaló Diego de Charras, actual presidente de la Red de Carreras de Comunicación Social y Periodismo durante el conversatorio.

Además, Busaniche asegura que los distintos tipos de responsabilidad atribuible serían de difícil implementación. “El régimen de responsabilidad de intermediarios, según se dictaminó en el caso Belén Rodríguez contra Google en 2014, establece responsabilidad subjetiva, y aquí Google actuó con celeridad, dando de baja el contenido injuriante, aun sin que la damnificada hubiera tenido que tomar cartas en el asunto. Atribuirle responsabilidad objetiva, por otro lado, marcaría un antecedente preocupante. Todas las relatorías de libertad de expresión, de Naciones Unidas, OEA, Unión Europea y demás, han planteado que no se les debe atribuir porque eso sería un incentivo muy fuerte para las empresas de ejercer un tipo de censura privada justamente para cuidar sus espaldas. Porque si ellos van a ser responsables de cada cosa que diga cualquier usuario de Internet, lo que vamos a tener son grandes máquinas de censura y de reducción drástica del espacio y de la esfera pública del debate”.

La disputa mediática fue uno de los elementos destacados durante la presidencia de Cristina Fernández. Las tapas agraviantes y las expresiones injuriosas se sucedieron a lo largo de toda su gestión. Basta con buscar, por ejemplo, algunas portadas de la revista Noticias. “Se trataba de acciones que podrían haberse catalogado como violencia simbólica contra una mujer –opina Busaniche–. Y ningún medio salió a pedir disculpas, ni a retirar algo que pudiera ser calumnioso. Al contrario, siempre ha escalado el nivel de agresión. Si uno analiza comparativamente la acción de Google, lo que se ve es que reaccionó rápido respecto a algo que se les escapó, la manipulación de los datos en Wikidata, y la información fue retirada de inmediato”. En otras palabras, para la especialista, “no podría demostrarse que la opinión de Google es que Cristina Fernández es una ladrona”. Pero el contenido fue difundido y amplificado por los medios de comunicación posteriormente.

La disputa mediática fue uno de los elementos destacados durante la presidencia de Cristina Fernández. Las tapas agraviantes y las expresiones injuriosas se sucedieron a lo largo de toda su gestión. Basta con buscar, por ejemplo, algunas portadas de la revista Noticias. “Se trataba de acciones que podrían haberse catalogado como violencia simbólica contra una mujer –opina Busaniche–. Y ningún medio salió a pedir disculpas, ni a retirar algo que pudiera ser calumnioso. Al contrario, siempre ha escalado el nivel de agresión. Si uno analiza comparativamente la acción de Google, lo que se ve es que reaccionó rápido respecto a algo que se les escapó, la manipulación de los datos en Wikidata, y la información fue retirada de inmediato”. En otras palabras, para la especialista, “no podría demostrarse que la opinión de Google es que Cristina Fernández es una ladrona”. Pero el contenido fue difundido y amplificado por los medios de comunicación posteriormente.

Entonces, ¿por qué Cristina decidió ir contra Google? Busaniche arriesga una hipótesis: “Intuyo que quiere meter algún tipo de discusión pública sobre el rol de las grandes empresas de Internet, en línea con muchos grandes líderes políticos a nivel global que lo están haciendo. Es un tema que se está discutiendo en el mundo. Hay que mirar también lo que está pasando con Donald Trump en su pleito con Twitter, algunos proyectos de ley sobre fake news en Brasil, algunas cosas que han estado pasando en Francia con los discursos de odio, las regulaciones sobre discurso racista en Alemania. Hay una corriente de muchos líderes políticos que están tratando de subirse a esta discusión. Probablemente, Cristina haya tomado esta decisión de entrar en la disputa y tratar de dirimir cuál es la responsabilidad de las plataformas”.

El camino de la regulación

Hasta el momento, en nuestro país no existe una ley que indique qué responsabilidad poseen las plataformas virtuales a la hora de indexar contenidos, ni tampoco una que imponga penas a acciones editoriales como las que se les atribuye a Google en la construcción del espacio destacado. Los pasos a seguir, en materia judicial, están orientados de forma jurisprudencial, es decir, en base a fallos previos. Las demandas iniciadas por Belén Rodríguez y Natalia Denegri (a favor del derecho al olvido) fueron dirimidas mediante fallos de la Corte Suprema, y sentaron precedentes de utilidad para litigios subsiguientes.

“Una buena regulación protectora de la libertad de expresión, ante todo en materia de responsabilidad de intermediarios, debería ser una de las políticas a acompañar”, afirma Busaniche, quien también subraya la necesidad de proteger el discurso público de la fuerte incidencia que tienen estas plataformas debido a los niveles extremos de concentración: “Como señaló Martin Becerra durante el conversatorio, si algo no puede circular por Facebook, por las distintas áreas de negocio de Google o por Twitter, probablemente no logre permear el discurso público, entonces la baja de contenidos y la protección del discurso de las figuras más débiles en esta ecuación, como somos los usuarios de las redes, también podría ser parte de una regulación interesante en estos entornos de grandes empresas de tecnología de Internet”.

El avance de los procesos de automatización mediante inteligencia artificial y la injerencia creciente de los algoritmos en sistemas que seleccionan, categorizan y deciden en los más diversos ámbitos de nuestra vida, ha traído el debate sobre la necesidad de regularlos. En Nueva Zelanda, el Ministerio de Estadística ha impulsado, desde el mes pasado, un acta que dispone revisar los procesos estatales basados en algoritmos y transparentar estos mecanismos a la población, explicándolos en un lenguaje sencillo y comprensible.

¿Se puede tomar algo de esta regulación? La directora de Vía Libre opina que sí: “El de Nueva Zelanda es un modelo pensado más que nada para el sector público, pero me parece que va en el sentido apropiado: mecanismos que permitan dotar de transparencia a los distintos sistemas de regulaciones mediadas por sistemas automatizados”. Existen iniciativas similares, incluso privadas. Tal es el caso de TikTok, que en su batalla con la administración Trump hizo públicos algunos lineamientos de su algoritmo y empezó a trabajar en una política interna a partir de la cual el usuario puede disponer de qué tipo de selección y decisiones se toman de sus contenidos y del acceso a ellos. “En Estados Unidos, por ejemplo, muchas decisiones se toman de esta forma: hay mecanismos algorítmicos para evaluar la posibilidad de que una persona recupere la libertad bajo palabra en el sistema carcelario, hay otros que definen si aceptar o no a una persona como cliente en un seguro médico, hay sistemas que evalúan la perfomance de docentes en escuelas públicas, hay otros que evalúan el otorgamiento o no de ayuda social. Está lleno de mecanismos algorítmicos, tanto del sector público como del privado, que están tomando decisiones que impactan sobre la vida de las personas. Y en el caso de las redes sociales, estos algoritmos, a su vez, impactan sobre lo que se ha empezado a llamar nuestra ‘dieta informativa’, qué cosas nos llegan en este mar inmenso de información que circula por Internet minuto a minuto”.

Estos procesos automatizados nos han ayudado a encontrar consumos de nuestro interés, a que Netflix nos sugiera la próxima película que nos puede llegar a gustar, o que Spotify o YouTube nos recomienden una banda que nunca escuchamos pero que tiene similitudes con otras que sí. Pero cuando se los plantea desde el punto de vista del acceso a la información, dice Busaniche, se ven tendencias como la exposición permanente a contenido extremista, como el discurso del alt right (derecha alternativa estadounidense), que han fortalecido mucho su posición en la vida pública, “no solo a partir de la exposición en la calle, sino que todo eso tiene una expresión en las redes y se le ha dado una visibilidad allí, ese tipo de contenido cada vez más extremo se visibiliza a partir de estos algoritmos. Por eso sería interesante saber cómo funcionan, qué variables toman en cuenta, en función de qué datos se exhiben o no ese tipo de contenidos”. La respuesta está en tener mayor y mejor acceso y transparencia los algoritmos y saber cómo construyen los resultados a partir del volumen de datos. Una discusión que recién comienza.